La Inteligencia Artificial ejemplifica el problema del 'viajero gratuito': he aquí por qué eso apunta a la regulación

Por Tim Juvshik*

El 22 de marzo de 2023, miles de investigadores y líderes tecnológicos, incluidos Elon Musk y el cofundador de Apple, Steve Wozniak, publicaron una carta abierta en la que pedían frenar la carrera de la inteligencia artificial. Específicamente, la carta recomendaba que los laboratorios detuvieran el entrenamiento para tecnologías más fuertes que GPT-4 de OpenAI, la generación más sofisticada de los sistemas de IA generadores de lenguaje actuales, durante al menos seis meses.

Hacer sonar la alarma sobre los riesgos que plantea la IA no es nada nuevo: los académicos han emitido advertencias sobre los riesgos de las máquinas superinteligentes durante décadas. Todavía no hay consenso sobre la probabilidad de crear inteligencia general artificial, sistemas de IA autónomos que igualen o superen a los humanos en la mayoría de las tareas económicamente valiosas. Sin embargo, está claro que los sistemas de inteligencia artificial actuales ya plantean muchos peligros, desde prejuicios raciales en la tecnología de reconocimiento facial hasta la creciente amenaza de desinformación y engaño de los estudiantes.

Si bien la carta pide que la industria y los formuladores de políticas cooperen, actualmente no existe un mecanismo para hacer cumplir tal pausa. Como filósofo que estudia la ética de la tecnología, me he dado cuenta de que la investigación de la IA ejemplifica el “ problema del free rider”. Yo diría que esto debería guiar la forma en que las sociedades responden a sus riesgos, y que las buenas intenciones no serán suficientes.

Viajando gratis

El parasitismo es una consecuencia común de lo que los filósofos llaman “problemas de acción colectiva”. Son situaciones en las que, como grupo, todos se beneficiarían de una determinada acción, pero como individuos, cada miembro se beneficiaría de no realizarla .

Dichos problemas comúnmente involucran bienes públicos. Por ejemplo, supongamos que los habitantes de una ciudad tienen un interés colectivo en financiar un sistema de metro, lo que requeriría que cada uno de ellos pague una pequeña cantidad a través de impuestos o tarifas. Todos se beneficiarían, pero lo mejor para cada individuo es ahorrar dinero y evitar pagar su parte justa. Después de todo, aún podrán disfrutar del metro si la mayoría de las personas pagan.

De ahí el problema del “viajero gratis”: algunas personas no contribuirán con su parte justa, pero aun así obtendrán un “viaje gratis”, literalmente, en el caso del metro. Sin embargo, si todos los individuos no pagaran, nadie se beneficiaría.

Los filósofos tienden a argumentar que no es ético "viajar gratis", ya que los usuarios gratuitos no pueden corresponder a otros que pagan su parte justa. Muchos filósofos también argumentan que los oportunistas fallan en sus responsabilidades como parte del contrato social, los principios cooperativos acordados colectivamente que gobiernan una sociedad. En otras palabras, no cumplen con su deber de ser miembros contribuyentes de la sociedad.

¿Pulsar pausa o seguir adelante?

Al igual que el metro, la IA es un bien público, dado su potencial para completar tareas de manera mucho más eficiente que los operadores humanos: todo, desde diagnosticar pacientes mediante el análisis de datos médicos hasta hacerse cargo de trabajos de alto riesgo en el ejército o mejorar la seguridad minera .

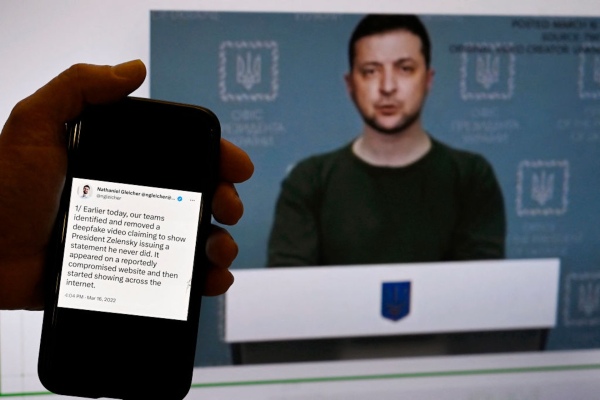

Pero tanto sus beneficios como sus peligros afectarán a todos, incluso a las personas que no usan IA personalmente. Para reducir los riesgos de la IA , todos tienen interés en que la investigación de la industria se lleve a cabo con cuidado, seguridad y con la supervisión y transparencia adecuadas. Por ejemplo, la desinformación y las noticias falsas ya representan serias amenazas para las democracias, pero la IA tiene el potencial de exacerbar el problema al difundir "noticias falsas" más rápido y de manera más efectiva que las personas.

La pantalla de un teléfono muestra una declaración del jefe de política de seguridad en Meta advirtiendo sobre un video falso del presidente ucraniano Volodymyr Zelenskyy. Olivier Douliery/AFP vía Getty Images

Sin embargo, incluso si algunas empresas de tecnología detuvieran voluntariamente sus experimentos, otras empresas tendrían un interés monetario en continuar con su propia investigación de IA, lo que les permitiría salir adelante en la carrera armamentista de la IA. Además, pausar voluntariamente los experimentos de IA permitiría a otras empresas obtener un viaje gratis al finalmente cosechar los beneficios de un desarrollo de IA más seguro y transparente, junto con el resto de la sociedad.

Sam Altman, CEO de OpenAI, ha reconocido que la empresa tiene miedo de los riesgos que plantea su sistema de chatbot, ChatGPT. “Tenemos que tener cuidado aquí”, dijo en una entrevista con ABC News, mencionando el potencial de la IA para producir información errónea. “Creo que la gente debería estar feliz de que estemos un poco asustados por esto”.

En una carta publicada el 5 de abril de 2023, OpenAI dijo que la compañía cree que los poderosos sistemas de IA necesitan regulación para garantizar evaluaciones de seguridad exhaustivas y que "comprometerá activamente con los gobiernos sobre la mejor forma que podría tomar dicha regulación". Sin embargo, OpenAI continúa con el lanzamiento gradual de GPT-4, y el resto de la industria también continúa desarrollando y entrenando IA avanzadas.

Maduro para la regulación

Décadas de investigación en ciencias sociales sobre problemas de acción colectiva han demostrado que cuando la confianza y la buena voluntad son insuficientes para evitar los oportunistas, la regulación suele ser la única alternativa. El cumplimiento voluntario es el factor clave que crea escenarios de oportunismo, y la acción del gobierno es a veces la forma de cortarlo de raíz.

Además, tales regulaciones deben ser exigibles. Después de todo, es poco probable que los posibles pasajeros del metro paguen la tarifa a menos que haya una amenaza de castigo.

Tomemos como ejemplo uno de los problemas más dramáticos del oportunista en el mundo de hoy: el cambio climático. Como planeta, todos tenemos un gran interés en mantener un entorno habitable. Sin embargo, en un sistema que permite a los pasajeros gratuitos, los incentivos para que cualquier país siga realmente pautas más ecológicas son escasos.

El Acuerdo de París, que actualmente es el acuerdo global más amplio sobre el cambio climático, es voluntario y las Naciones Unidas no tienen ningún recurso para hacerlo cumplir. Incluso si la Unión Europea y China limitaran voluntariamente sus emisiones, por ejemplo, Estados Unidos e India podrían “viajar gratis” en la reducción de dióxido de carbono sin dejar de emitir.

Los líderes mundiales celebran la adopción del histórico pacto sobre el calentamiento global en la conferencia sobre cambio climático COP21 de la ONU en 2015. Francois Guillot/AFP vía Getty Images

Reto global

De manera similar, el problema del pasajero gratuito fundamenta los argumentos para regular el desarrollo de la IA. De hecho, el cambio climático es un paralelo particularmente cercano, ya que ni los riesgos que plantea la IA ni las emisiones de gases de efecto invernadero están restringidos al país de origen de un programa.

Además, la carrera para desarrollar una IA más avanzada es internacional. Incluso si EE. UU. introdujera una regulación federal de investigación y desarrollo de IA, China y Japón podrían viajar libremente y continuar con sus propios programas nacionales de IA .

La regulación y el cumplimiento efectivos de la IA requerirían una acción colectiva y cooperación global, al igual que con el cambio climático. En los EE. UU., la aplicación estricta requeriría la supervisión federal de la investigación y la capacidad de imponer fuertes multas o cerrar los experimentos de IA que no cumplan con los requisitos para garantizar un desarrollo responsable, ya sea a través de juntas de supervisión regulatoria, protección de denunciantes o, en casos extremos, cierres de laboratorio o investigación, y cargos criminales.

Sin embargo, sin la aplicación de la ley, habrá oportunistas, y los oportunistas significan que la amenaza de la IA no disminuirá en el corto plazo.

*Escrito por Tim Juvshik para The Conversation (nota original en inglés)

Tim Juvshik Profesor Asistente Visitante de Filosofía, Universidad de Clemson